NVIDIA RTX PRO 6000 Blackwell Server mit CUDA 13, SGLang, Qwen

High-End KI-GPU-Hosting mit NVIDIA RTX PRO 6000 Blackwell, CUDA 13 und SGLang

menkiSys erweitert seine KI-GPU-Infrastruktur und testet derzeit eine neue High-End-Plattform auf Basis von zwei NVIDIA RTX PRO 6000 Blackwell GPUs mit jeweils 96 GB vRAM. Damit stehen in diesem System insgesamt 192 GB GPU-Speicher für moderne KI-Workloads, Large Language Models, Inference, Vision-Language-Modelle, GPU-Computing und professionelle AI-Anwendungen zur Verfügung.

Der eingesetzte Server basiert auf einer leistungsstarken AMD EPYC Plattform mit 64 CPU-Kernen, 512 GB RAM und zwei NVIDIA RTX PRO 6000 Blackwell GPUs. Der gesamte Hardwarewert inklusive Server-System liegt bei über 60.000 EUR. Damit betreibt menkiSys eine exklusive KI-Infrastruktur, die speziell für anspruchsvolle Unternehmen, Entwickler, IT-Dienstleister, Forschungseinrichtungen und professionelle AI-Projekte interessant ist.

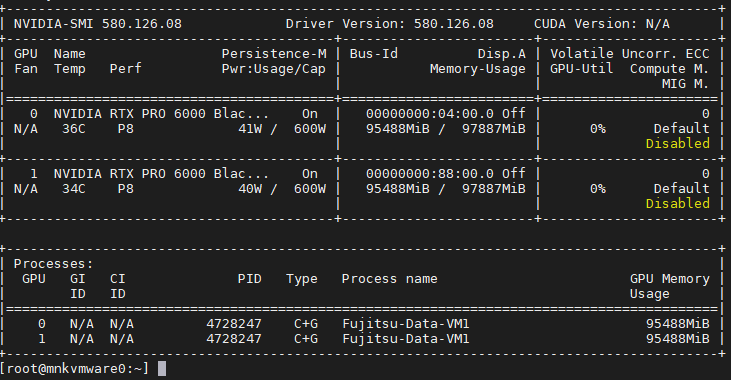

Im aktuellen Testbetrieb wurde der neue NVIDIA-Treiber erfolgreich eingesetzt:

NVIDIA Driver Version: 580.126.08

CUDA Version: 13

Besonders relevant ist, dass der produktionsnahe Test mit SGLang, CUDA 13, FlashInfer und dem Modell Qwen2.5-VL-32B erfolgreich gestartet werden konnte. Während andere Konstellationen im Test nicht erfolgreich waren, funktionierte die CUDA-13-Variante mit dem passenden SGLang-Container zuverlässig. Das zeigt, wie wichtig aktuelle Treiber, passende Container-Images, NVIDIA Runtime, CUDA-Versionen und korrekt abgestimmte Inference-Parameter im Bereich moderner KI-Infrastruktur sind.

Getestet wurde unter anderem mit folgendem technischen Stack:

docker run -d --name qwen-sglang-cu13 \

- --runtime=nvidia \

- --device nvidia.com/gpu=all \

- --ipc=host \

- --ulimit memlock=-1 \

- --ulimit stack=67108864 \

- --shm-size=64g \

- -p 30320:8000 \

- -v /opt/llm-models/qwen2.5-vl-32b:/opt/llm-models/qwen2.5-vl-32b:ro \

- lmsysorg/sglang:dev-cu13 \

- python3 -m sglang.launch_server \

- --model-path /opt/llm-models/qwen2.5-vl-32b \

- --host 0.0.0.0 \

- --port 8000 \

- --mem-fraction-static 0.92 \

- --max-running-requests 128 \

- --max-total-tokens 114688 \

- --chunked-prefill-size 16384 \

- --max-prefill-tokens 32768 \

- --schedule-policy lpm \

- --attention-backend flashinfer \

- --sampling-backend flashinfer \

- --cuda-graph-bs 1 2 4 8 16 32 48 64 \

- --log-level info

Dieser Test ist für menkiSys ein wichtiger technischer Meilenstein. Er zeigt, dass aktuelle KI-Modelle und moderne Inference-Engines auf einer professionellen NVIDIA-Blackwell-Plattform im menkiSys Rechenzentrum betrieben werden können. Die Plattform eignet sich für LLM-Inference, eigene KI-Assistenten, Chatbots, API-basierte KI-Dienste, RAG-Systeme, Dokumentenanalyse, Bildanalyse, Vision-Language-Modelle, AI-Agenten, Softwareentwicklung mit KI-Unterstützung, Machine Learning, Rendering und weitere GPU-intensive Workloads.

Besonders interessant ist diese Infrastruktur für Unternehmen, die Modelle wie Qwen, Llama, Mistral, Mixtral, DeepSeek, Gemma oder andere Open-Source-LLMs betreiben möchten. In Kombination mit Technologien wie Open WebUI, SGLang, vLLM, Ollama, LiteLLM Proxy, Docker, NVIDIA Container Runtime, CUDA 13 und FlashInfer lassen sich leistungsfähige KI-Plattformen für interne und externe Business-Anwendungen realisieren.

menkiSys bietet damit nicht nur klassische Server- und Hosting-Infrastruktur, sondern entwickelt aktiv moderne Lösungen für KI-GPU-Hosting, LLM-Hosting, AI-API-Bereitstellung, Private-AI-Plattformen und DSGVO-konforme KI-Infrastruktur aus Österreich.

Ein wesentlicher Vorteil für Unternehmen liegt darin, dass keine eigene Investition in teure GPU-Hardware, Kühlung, Stromversorgung, Treiberpflege, Serverbetrieb und Rechenzentrumsinfrastruktur notwendig ist. Stattdessen können Kunden auf professionelle NVIDIA-GPU-Server im menkiSys Rechenzentrum zugreifen und ihre KI-Projekte auf einer stabilen, leistungsfähigen und kontrollierten Plattform betreiben.

Ein aktueller Screenshot aus dem Testsystem zeigt die NVIDIA RTX PRO 6000 Blackwell GPUs im Betrieb:

Mit dieser Plattform positioniert sich menkiSys als österreichischer Anbieter für professionelle KI-GPU-Server, NVIDIA Blackwell Hosting, LLM-Infrastruktur und Enterprise-AI-Workloads. Unternehmen, Entwickler und IT-Dienstleister erhalten Zugriff auf exklusive High-End-GPU-Leistung, ohne selbst Hardware im Wert von über 60.000 EUR anschaffen und betreiben zu müssen.

Wer eigene KI-Modelle, Open WebUI, Qwen, Llama, Mistral, SGLang, vLLM, Ollama, LiteLLM oder eine OpenAI-kompatible API auf leistungsfähiger GPU-Infrastruktur betreiben möchte, kann sich direkt an menkiSys wenden.

Video: Einsatz der menkiSys NVIDIA Blackwell GPU

Relevante Themen:

NVIDIA RTX PRO 6000 Blackwell, NVIDIA Blackwell GPU Server, CUDA 13, NVIDIA Driver 580.126.08, KI-GPU-Server Österreich, GPU Server mieten, vGPU Server mieten, LLM Hosting, Qwen Hosting, Llama Server, Mistral Server, Open WebUI Hosting, SGLang Server, vLLM Hosting, Ollama Server, LiteLLM Proxy, AI API Hosting, Private AI Cloud, DSGVO-konforme KI-Infrastruktur, Enterprise AI Hosting, GPU Inference Server und dedizierte NVIDIA GPU Server von menkiSys.

« Zurück